Post escrito por Paula Pappalardo (con aportes de Elizabeth Hamman, Jim Bence, Bruce Hungate & Craig Osenberg)

This post is also available in English.

Pasaste meses laboriosamente colectando datos de artículos científicos acerca de tu pregunta favorita, tienes decenas de artículos perfectamente organizados en una base de datos, ya encontraste el programa o código para analizar los datos, y entonces imaginas como tu publicación va a ser la más citada en tu campo de investigación mientras haces unos gráficos lindísimos. Si esto te suena familiar, seguramente has hecho un meta-análisis. Un meta-análisis usa modelos estadísticos para combinar datos de distintas publicaciones para responder a una pregunta específica.

Lo que quizás no te diste cuenta mientras navegabas los pasos del meta-análisis, es que pequeñas decisiones (a veces pareciendo de muy poca importancia) pueden tener grandes efectos en los resultados. Si quieres saber más acerca de una de estas decisiones en particular… ¡sigue leyendo!

Intervalos de incertidumbre utilizados en meta-análisis en el área de Ecología

La mayoría de nosotros conoce los intervalos de confianza basados en la distribución normal (que también se conoce como distribución-z) porque son usados frecuentemente, aparecen en los libros de texto, y tienden a ser el intervalo de confianza por defecto para calcular un tamaño de efecto promedio en los programas de meta-análisis. Idealmente, un intervalo de confianza va a reflejar la cobertura, que es la probabilidad de que un intervalo de confianza incluya al tamaño de efecto real. En otras palabras, un intervalo de confianza del 95% debería incluir el tamaño de efecto real 95% del tiempo. El problema es que la distribución normal está basada en la premisa de una gran cantidad muestras, y los ecólogos que realizan un meta-análisis pueden no tener la cantidad de estudios suficientes para justificar esa premisa. Si el número de estudios es bajo y se utiliza la distribución normal, los intervalos de confianza pueden ser muy estrechos, lo que puede llevar a una cobertura baja, dando la falsa impresión de que los resultados son más precisos de lo que son en realidad.

Afortunadamente, hay otras maneras de generar intervalos de confianza que son menos susceptibles a este error de exagerada precisión. ¿Cuáles son? En nuestro paper reciente en Methods in Ecology and Evolution (escrito por mi junto con Kiona Ogle, Elizabeth Hamman, Jim Bence, Bruce Hungate & Craig Osenberg) nosotros investigamos el desempeño de los métodos frecuentistas tradicionales y métodos bayesianos para estimar un tamaño de efecto promedio y su intervalo de incertidumbre. En la literatura del área de Medicina, es común encontrar meta-análisis con un bajo número de estudios en analisis de enfermedades raras. Para lograr buena cobertura cuando el número de estudios es bajo, los artículos metodológicos en el área de Medicina recomiendan usar el método de Hartung-Knapp-Sidik-Jonkam (HKSJ). El método HKSJ combina un estimador ajustado de la varianza entre estudios con una distribución t de Student. En el área de Ecología, los intervalos de confianza basados en remuestreo (bootstrap) han sido recomendados porque son robustos a desviaciones de la normalidad. Y cuando el meta-análisis se realiza en un marco bayesiano, se pueden obtener intervalos de credibilidad, que son equivalentes a un intervalo de confianza. Mucha gente considera que los intervalos de credibilidad ofrecen una interpretación más directa que los intervalos de confianza, pero si dependen de una distribución que tiene que ser definida de antemano (distribución a priori). Aunque la curva de aprendizaje de los métodos bayesianos es empinada, y resulta intimidante para los principiantes, su uso está aumentando entre los ecólogos.

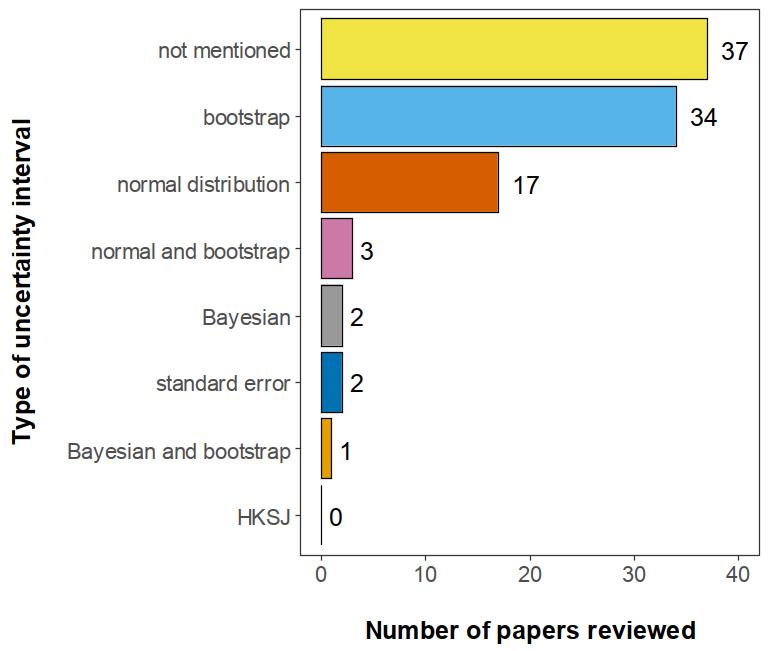

En “Comparing traditional and Bayesian approaches to ecological meta-analysis”, encontramos que la mayoría de los autores reportaron intervalos de confianza de remuestreo o de distribución normal. Nos sorprendió descubrir que 39% of los meta-análisis que revisamos no reportaron el tipo de intervalo de confianza usado para estimar la incertidumbre en el tamaño de efecto promedio.

¿Qué tan importante es (y qué hacemos al respecto)?

Simulaciones de meta-análisis pueden ser útiles para explorar que tipo de intervalo de confianza (o de credibilidad) tiene mejor desempeño para medir la incertidumbre alrededor de un tamaño de efecto promedio. Cuando uno corre una simulación, es importante simular una base de datos que refleje los datos de interés, en este caso, datos encontrados por ecólogos. Nuestra revisión de meta-análisis en el área de Ecología encontró que la mayoría de los meta-análisis compilaron estudios con bajo número de réplicas (mediana = 5), e incluyeron un número relativamente bajo de estudios para estimar un tamaño de efecto promedio (mediana = 44). Una revisión previa de meta-análisis en Ecología y Evolución mostró alta heterogeneidad, la última pieza del rompecabezas necesaria para simular datos representativos de meta-análisis en ecología. Es en estas condiciones que basamos nuestro experimento de simulación.

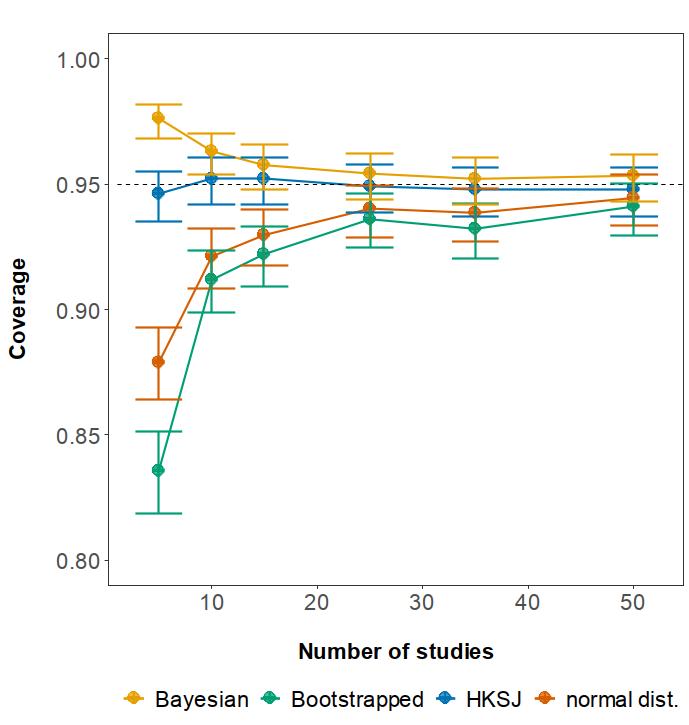

El número de estudios incluidos en el meta-análisis fue el factor más importante para determinar el desempeño de los intervalos de incertidumbre. Para simplificar, nos referimos a desempeño “bueno” cuando la cobertura del intervalo de confianza correspondió con el valor nominal (es decir, los intervalos de confianza de 95% incluyeron el tamaño de efecto real 95% de las veces), y desempeño “malo” cuando la cobertura se desvió del valor nominal.

Como sospechábamos, el intervalo de confianza basado en la distribución normal (que es la distribución por defecto usada en muchos programas para realizar meta-análisis) no tuvo buen desempeño cuando el número de estudios fue menor a 40. También encontramos que el intervalo de confianza con el método de remuestreo no tuvo buen desempeño. Solo el intervalo de credibilidad bayesiano y el método HKSJ frecuentista alcanzaron buena cobertura. Sin embargo, estos métodos se usaron en menos del 3% de los meta-análisis que consultamos en la revisión bibliográfica.

Nuestros consejos para ecólogos

- Revisar las configuraciones por defecto, para saber que intervalo de confianza es utilizado al hacer un meta-análisis, y más importante, reportar el tipo de intervalo.

- En caso de realizar un meta-análisis simple con efectos aleatorios usando métodos frecuentistas, recomendamos usar el intervalo de confianza HKSJ. En el paquete de R “metafor”, uno de los paquetes más populares para hacer un meta-análisis, esto se puede especificar fácilmente con la opción knha = T..

- Si se tiene un bajo número de estudios al hacer un meta-análisis, tener en cuenta que los intervalos de confianza usando la distribución normal o la técnica de remuestreo pueden generar baja cobertura, y generar falsos resultados positivos.

- Si estás lista/o para un desafío que vale la pena, prueba usar un método bayesiano, que también tiene buen desempeño.

Para encontrar mas consejos acerca de que intervalos de incertidumbre usar en meta-análisis en el área de Ecología, lee nuestro artículo en Methods in Ecology and Evolution titulado ‘Comparing traditional and Bayesian approaches to ecological meta-analysis’